ChatGPT работает, анализируя огромные объемы текста, выявляя закономерности и синтезируя их для генерации ответов на запросы пользователей. Цветовые метафоры, такие как «чувствовать себя синим» (грустить) или «видеть красное» (злиться), широко распространены в английском языке и поэтому входят в набор данных, на которых обучается генеративная модель.

Искусственный интеллект «прочитал» миллиарды слов о том, что значит чувствовать себя синим или видеть красное, но никогда на самом деле не видел голубого неба или красного яблока так, как лицезрели их мы. Это поднимает вопросы: помогают ли телесные переживания — способность человеческой зрительной системы воспринимать цвет — людям понимать цветовой язык глубже, чем это делает ChatGPT на основе текста? Или для этого достаточно лишь текста?

Новое исследование в журнале Cognitive Science, которое проводили психологи, нейробиологи, социологи, компьютерные ученые и даже астрофизики, раскрывает эти загадки — и ставит еще больше вопросов.

«ChatGPT использует огромное количество лингвистических данных для вычисления вероятностей и генерации очень человекообразных ответов, Но нас интересует, остается ли это формой вторичного знания по сравнению с человеческим знанием, основанным на непосредственном опыте», — говорит профессор Лиза Азиз-Заде, возглавляющая Центр нейробиологии телесного знания в Южно-Калифорнийском университете.

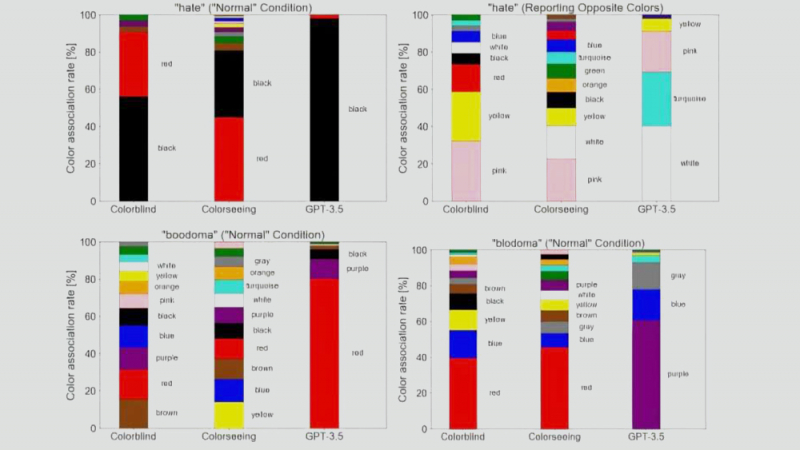

Исследователи провели масштабные онлайн-опросы, сравнивая четыре категории участников: взрослых с нормальным зрением, дальтоников, художников, регулярно работающих с цветами, и ChatGPT. Каждой группе было предложено сопоставить цвета с абстрактными словами, такими как «физика». Их попросили также расшифровать знакомые цветовые метафоры («они были в красной тревоге») и незнакомые («это была очень розовая вечеринка»), а потом объяснить свои рассуждения.

Вопреки ожиданиям экспериментаторов, люди с нормальным зрением и дальтоники оказались удивительно похожи в своих цветовых ассоциациях — то есть зрительное восприятие не обязательно для понимания метафор. Художники показали значительный прогресс в правильной интерпретации новых цветовых метафор. Это позволяет предположить, что практический опыт работы с цветом раскрывает более глубокие концептуальные представления о нем в языке.

ChatGPT также демонстрировал высокую согласованность в цветовых ассоциациях и, когда его просили объяснить свои рассуждения, часто ссылался на эмоциональные и культурные ассоциации с различными цветами. Например, объясняя метафору «розовой вечеринки», ChatGPT ответил: «Розовый часто ассоциируется со счастьем, любовью и добротой, что предполагает, что вечеринка была наполнена положительными эмоциями и хорошей атмосферой».

Однако он реже, чем люди, использовал объяснения, основанные на телесном опыте, и чаще делал ошибки в интерпретации новых метафор («встреча сделала его бордовым») или инверсии цветовых ассоциаций («противоположность зеленому»).

По мере развития ИИ подобные исследования подчеркивают ограничения языковых моделей в отражении всего спектра человеческого понимания. Будущие исследования могут изучить, может ли интеграция сенсорных данных — например, визуальных или тактильных — помочь моделям ИИ приблизиться к человеческому мышлению.

«Этот проект показывает, что все еще есть разница между имитацией семантических паттернов и спектром человеческой способности опираться на телесный, практический опыт в наших рассуждениях», — подытожила Азиз-Заде.